设计师经常利用心理学和行为学知识影响或改变用户的认知和行为,可能考虑了法律的约束,却没有考虑对应的伦理和道德规范,下面的文章将会着重讨论这方面的内容。

本文要点:

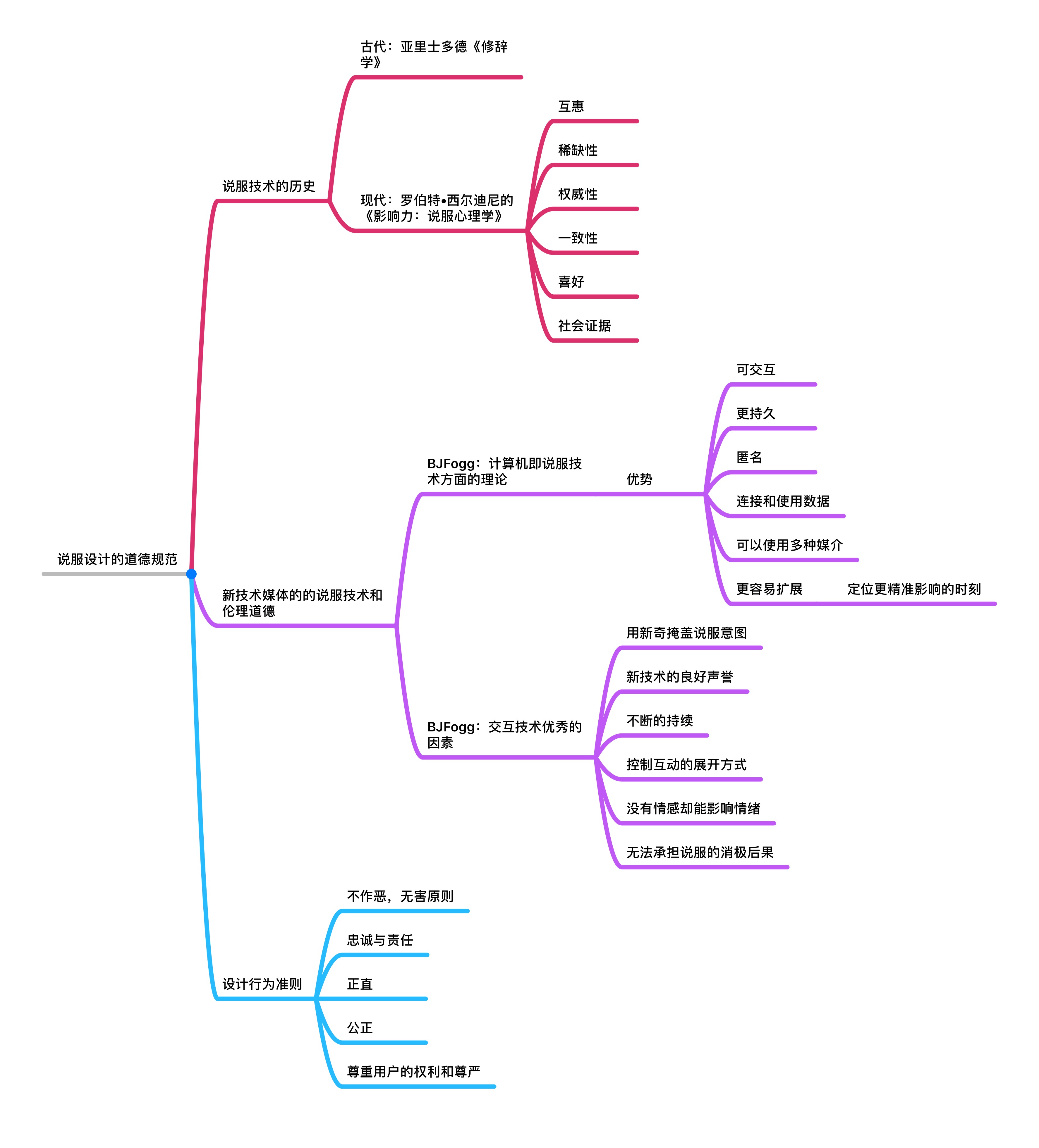

- 说服技术的发展

- 新技术媒体下的说服技术及伦理道德

- 说服设计行为规范

摘要:如今用户对网络邮件诈骗、网络钓鱼攻击、及数据泄露越来越谨慎。本文抛砖引玉,避免设计师和开发者跨越道德底线进入说服的黑暗面。

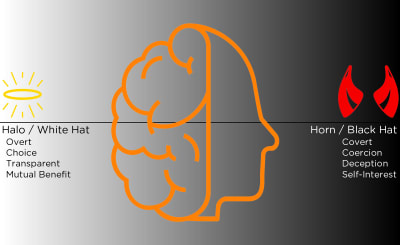

几个月以前,剑桥分析公司使用脸书性格测试应用数据,利用广告剖析和定位更多受众并说服他们进行特定方式投票,这种不道德行为,震惊了全世界。只有部分数据获得授权(!),应用设计者存储了数据 (!! ),违反使用条款,将数据卖给了剑桥分析公司(!!!) 。这是个典型黑帽设计案例,欺骗性的使用说服技巧,不道德使用个人信息。

再讲一个例子,你上次购物的时候,可能发现很多应用使用了鼓励你继续购买的设计元素(如“上次购买的商品”“昨天看了3次的商品”)。尽管这些设计技术试图说服用户,但通常不是欺骗性的,是白帽说服技巧。

第三个案例是上个月Google的I/O大会,全世界一起见证了Google Duplex模仿人类给一家理发沙龙打电话预约的情景。对话非常流畅,接电话的人都没有意识到在跟一个机器通话。这个AI既没有说自己是人,也没有表明自己是机器,是灰色区域设计。在不久的将来,谁可以阻止它被用于黑帽设计呢?

如你在上述三个例子看到的一样,说服技巧的运用可以从一个极端(黑帽)到另一个极端(白帽),而且中间有大片灰色区域。当今社会,网络邮箱诈骗,钓鱼攻击,及数据泄露,人们对不考虑他们利益的说服技巧越来越谨慎。体验设计师,开发者、及造物者要对我们在设计中使用的技巧的道德性质负责。

本篇文章会概述一下说服的历史,看看说服是如何与技术和新媒体结合使用的,并为设计师及开发者提供思考材料,避免跨越道德底线进入说服的黑色地带。

说服的历史

说服技术并不新鲜,已经存在很久了。2000多年前的亚里士多德的《修辞学》就是说服技术的最早典籍之一。亚里士多德提出的说服模式是ethos(信任),logos(逻辑),和pathos(情感)。他也讨论了kairos(时机)对说服模式的重要性。

快进到现代,我们可以看到说服方法在广告、营销和传达方面的广泛应用。在说服别人信任某个观点或赢得下一个设计客户或项目时,很可能我们也在使用说服技术:一个人的观点或行为在没有强迫的情况下,通过沟通受到他人影响的过程。

尽管亚里士多德首先记录了说服技术,在讨论现代说服的时候,人们通常引用Robert Cialdini的《影响力:说服心理学》。根据Cialdini的观点,有六种关键的说服原则(译者注:之前在其他网站上翻译了一部分,点击下面的链接可以在博客中看到。):

01 互惠原则

人们在接受某些东西的时候会感觉需要给些东西作为回报。

02 稀缺性

人们更想要那些想获得但数量不足的东西。

03 权威性

人们倾向遵从可信且有学问的专家的指挥或领导。

04 一致性

人们喜欢与过去言行保持一致。

05 喜欢

人们更喜欢对自己喜欢的人或事情说“是”

06 共识(社交证据)

尤其在不确定的时候,人们会看其他人的行为决定自己如何做。

我们都接触过其中一两个原则,且能在广告和其他人交往中识别出来。尽管说服已经存在很多年了,说服技巧对新技术和媒体的运用还是比较新鲜的事情。从个人电脑开始,到互联网时变得突出,而现在在移动设备中已经很普遍了。

使用技术和新媒体的说服方法

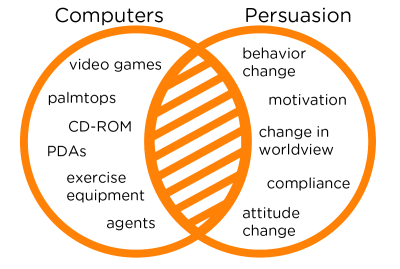

行为科学家B.J.Fogg是使用新技术进行说服的先驱。在20年前,他就开始探索说服与计算机技术的关系。其中包含设计出来用户改变人们观点或行为的各种交互技术,如网站、软件及硬件设备等。他称这个领域为captology,是计算机即是说服技术(computers as persuasive technologies)的缩写,并撰写了此领域的书籍《说服技术:使用计算机改变我们的思想和行为》

相对传统媒体,因为可交互,交互技术拥有很多优点。相比人类优点更多,更持久(如软件更新提醒),可以匿名(对敏感话题很有用),可以连接并使用大量数据量(如,亚马逊推荐),可以使用更多风格和模式(文本,图像,音频、视频和模拟),更容易扩展,而且很普遍。

随着智能手机变成了手臂的延伸,最后一个优势更加明显,且正随着智能设备、内嵌式计算机、物联网、可穿戴设备、增强现实、虚拟现实以及被可以嵌入到任何东西的AI增强虚拟助越来越普遍。此外,技术的进步让我们可以更精准地测定并定位更有影响力的说服时刻。因为很容易得到用户的位置、情景、时间和所做的事情,并赋予他们采取对应行为的能力。可能是你的智能手表提醒你站立或行走,或离你几条街的咖啡店的邀请。

新技术和交互媒体的伦理道德

过去几十年说服技术在传统媒体中的应用带来了不少道德问题。新兴媒体和普世技术的发展,将会带来更多说服使用的道德问题,其中一些是普世技术比传统媒体和人类的优势带来的。任何使用说服技术改变人们观点或行为的人都应该深刻了解自己工作的道德意义及影响。

设计师的关键责任之一是鼓励用户。在可以运用说服技术的设计中,这个角色变得更加重要,因为用户可能并不了解这些说服技巧。更糟糕的是,一些用户甚至无法识别这些技巧,如儿童、老人或其他脆弱的用户。

在说服方面,BJ Fogg提供了6种让交互式技术优于用户的因素:

01 用新奇掩盖说服意图

网络和电子邮件已不是什么新鲜事,我们也习惯了各种网络欺诈和尼日利亚王子骗局(译者注:指的是一种声称有巨额财富需要转移,使用受害者账号,并骗取各种费用的行骗手段。),不过在移动应用、语音交互、AR、VR等领域仍有不少新鲜的事物。不久前,对精灵宝可梦(Pokemon Go)的狂热就引发了很多道德问题。

02 新技术的良好声誉

尽管”这肯定是真的,我在网上看到过”已经变成了笑话,但用户仍然在被说服去点赞、评论、分享、传播挑战,并让假新闻或机器生成的内容像病毒一样传播。

03 不断的坚持

你喜欢在你第一次造访时,二手车销售员就跟在你后面不断试图说服你购买一辆车吗?尽管这并没有在现实生活中发生,你的应用和智能设备却一直伴随着你,叮叮的声音和闪亮的屏幕就有持续说服你的能力,即使在不怎么合理的时间和地点也这样。这个大斋节(译者注:西方节日,亦称“齐斋节”,自圣灰星期三开始至复活节前的40天,在此期间进行斋戒和忏悔),我儿子暂时不再玩他的移动设备。等他复活节再次玩的时候,他有数百个来自各种移动游戏的通知和提醒,提供各种提示和激励让他回来继续使用玩。

04 控制互动的展开方式

与人类说服(被说服的人有能力反对或离开)不一样,技术有各种创建者、设计师或开发者预设的选项。设计语音用户界面时,创建者必须定义它有什么功能,其他事情只能反馈“对不起,这超出了我的能力”。就在上个月,一家社交网络不再让我访问他们的移动网站,要求我必须安装应用才能访问内容,但没有提供任何离开或忽略的选项。

05 没有情感却能影响情绪

新技术没有情感。即便是最新的人工智能,机器也不会像人类一样感受情感。回到开始提到的Google Duplex助理打电话的例子,当人们没有意识到对面的语音只是来自一个没有情感的机器,并像对待像自己一样的人来对待它,就有问题了。

06 无法承担说服的消极后果

如果出错了,应用和技术承担不了责任怎么办?如果说服策略出现了意外的后果,或被合作者误用了,创造者应不应该承担责任呢?在国会听证会之前及其过程中,马克·扎克伯格承认对剑桥分析公司丑闻负有责任。

有这么多不公正的优势,创造者、设计师及开发者在进行设计和方案决策时怎么办呢?首先,请退一步,思考下我们工作的道德含义和影响,然后为我们的用户站台。

很多设计师反对和抨击本身有道德伦理问题的技术产品和设计。其中,前谷歌设计伦理学家特里斯坦·哈里斯( Tristan Harris)公开表达过高科技公司的产品是如何劫持用户思维的;Napster创始人和前脸书董事长肖恩·帕克(Sean Parker)曾描述过脸书是如何利用人类“脆弱点”的;Basecamp的杰纳斯·唐尼(Jonas Downey)反思了商业利益与用户利益向左时,公司是怎么持有并运行大部分软件产品的。

设计行为准则

全球最大的设计专业会员组织AIGA关于设计行业与伦理道德方面就有很多文章。《设计职业化》的作者安迪·拉特里奇也创建了设计专业行为准则。两者都很详细,涵盖了设计行业的方方面面,但并不是专注于影响人类行为设计相关的伦理的。

其他影响人类心智的职业都有道德规范和行为准则,如美国心理学会和英国心理学会发表的各种文章。这些行为准则目的是为了保护参与者以及心理学和心理学家本身的名声。当我们在设计中使用心理学时,我们需要检验心理学家的道德规范怎么适用于创建者、设计师和开发者。

原则和问题

使用心理学家道德规范作为模板,我定义了每个原则如何适用于说服设计并列举了设计的道德影响相关的问题。这些并不是很详尽,目的是抛砖引玉,激发各领域的思考。注意:你在下面问题中看到的“设计”,指的是你设计、应用、产品或解决方案中使用的说服技术。

原则A:善行和无害原则

不作恶。你的决定可能会影响用户及其身边人的思想、行为和生活,所以需要警觉并提防滥用设计的影响力。

- 你的设计是否改善了人们的交互方式?

- 设计目的是不是让用户花他们不想花的时间?

- 设计是否让用户通常无法轻易获取的,且社会不接受或非法的东西更易得?

- 有多少合作方(包括第三方工具和工具包)或“坏孩子”在来滥用你的设计,而你却不知道?

- 他人对你用你的设计,是否舒适?

- 你想他人用你的设计说服你的母亲或孩子吗?

原则B:忠诚与责任

注意你对目标用户、非目标用户及整个社会的责任。为你的设计后果承担必要的责任。

- 设计过程中,有没有一直探寻“我们怎么可以……?”和“以什么为代价?”等问题的答案?

- 你的设计/产品/方案会有什么影响?它会取代或影响谁或什么?

- 如果设计的实际用途与你预想的相反,会有什么影响?

- 你的设计是否会让社会规范、利益和传统更美好?

- 设计是否会有意或无意的伤害用户或让他们变脆弱?(研究估计Pokemon GO造成了超过100000起交通事故)应该怎么阻止?

原则C:正直

在设计中提高准确性、诚实和真实。不要作弊、歪曲事实或进行任何欺诈行为。在最大化利益并最小化伤害时,欺骗可能道德上是正当的,请仔细思考纠正此类技术应用引起的不信任或其他有害影响的需要、可能后果及责任。

- 你需要用户同意吗?在要求同意时,用户清楚他们在同意什么嘛?

- 设计的目的是什么?它符合用户和创造者的最佳利益吗?你对自己意图开放透明吗?

- 你的设计使用了欺骗、控制、误导、威胁、强制或其他不诚实的技术吗?

- 用户知道或被告知自己被监控吗,还是隐藏的?

- 你的设计会伤害用户利益为自己或创造者获益吗?

- 未来揭发的人会怎么评价你和你的设计?

原则D:公正

运用合理的判断和必要的预防措施,确保你的潜在偏见、专业知识的局限性不会导致或容忍不公正的实践。你的设计应该让创造者和用户都受益。

- 你的设计包含设计师固有的偏见(性别、政治或其他)吗?

- 你的设计主张仇恨、暴力、犯罪、强制灌输吗?

- 如果你不用技术,亲自去这么做道德吗?

- 公司和创建者的收益是什么?用户的收益是什么?这些好处是否对业务有利?

- 你是否让用户很容易离开?用户可以控制或有能力停止,而不会在其他渠道中再次被说服吗?

原则E:尊重用户的权利和尊严

尊重所有人的尊严和价值,尊重个人隐私和保密的权利。保护脆弱人群(儿童和老人)的权利和幸福可能有必要采取特殊保护措施。

- 你的设计会对弱势群体(孩子、老人等)使用说服技术吗?

- 你的设计会保护用户隐私并让他们自己控制设置吗?

- 设计是否需要不必要的条款才能使用?

- 设计可以是用非传统技术获得同样结果吗?(如使用速度检测器代替监视器)

- 你的设计会让用户讨厌或伤害他人吗?你怎么阻止呢?

结论

如果你在使用白帽技术设计,可能会喜欢这里探讨的伦理道德问题。但,如果你在灰色或黑色技术进行设计,希望你可以终止。说服设计中的伦理道德是非常重要的,因为交互式技术不应该瞄准用户的劣势。作为造物者、设计师及开发者,我们有责任保护我们的用户。

请扫描下方公众号二维码或搜索公众号Forbetterworld,

也可以造访博客Forbetterworld.cn,精彩内容同步更新

观点归原作者所有,欢迎留言讨论,分享转载。

英文版地址:The Ethics Of Persuasion